如何形象化地理解“AI、大模型、GPT”,?

近來,關(guān)于人工智能(AI)的討論此起彼伏,,其中不可避免地涉及到一些術(shù)語和概念,,然而用簡單易懂的方式向非專業(yè)人士解釋是非常具有挑戰(zhàn)性的。作者嘗試把AI與人類學(xué)習(xí)和成長的類比,,通過將AI與人們熟悉的事物進(jìn)行比較的方式,,簡要介紹AI相關(guān)的原理、進(jìn)展和意義,。歡迎閱讀~

自從ChatGPT橫空出世以來,,AI領(lǐng)域再次引起了廣泛關(guān)注。

最近,,有關(guān)AI的討論絡(luò)繹不絕,,其中不可避免地涉及到一些諸如“樣本、預(yù)訓(xùn)練,、大模型”等概念和術(shù)語,。

然而,要用淺顯易懂的方式向非專業(yè)人士解釋這些概念是相當(dāng)具有挑戰(zhàn)性的,。

但這對于自己和他人,,都很有價(jià)值。

正如愛因斯坦所言:“If you can’t explain it simply, you don’t understand it well enough(如果你不能簡單地解釋,,那就說明你理解不夠)”,。

今天,我嘗試把AI與人類學(xué)習(xí)和成長的類比,,通過將AI與人們熟悉的事物進(jìn)行比較的方式,,簡要介紹AI相關(guān)的原理、進(jìn)展和意義,。

帶過小孩的家長都會有這樣一個(gè)感覺:突然有一天發(fā)現(xiàn)孩子會說話了,、會走路了,。

這個(gè)過程并非像“0%、1%,、2%…98%,、99%、100%”這樣逐個(gè)百分點(diǎn)緩慢提升,,而是有一天突然發(fā)生了變化,。

模型的“涌現(xiàn)”指的是在大量訓(xùn)練數(shù)據(jù)和復(fù)雜模型結(jié)構(gòu)的支持下,模型突然表現(xiàn)出較高的性能和新的能力,。

簡單來說,,就是“量變引起質(zhì)變”的過程。

當(dāng)訓(xùn)練樣本足夠大,、算法迭代達(dá)到一定階段時(shí),,模型的能力會突然提高。

能力“涌現(xiàn)”的前提,,是大量不斷的輸入,。

自孩子出生起,盡管他們聽不懂,、不會說,,但家長要不斷與孩子互動,跟他說話,。在日積月累的過程中,,有一天孩子的說話能力就會“涌現(xiàn)”出來。

模型的發(fā)展過程也類似,。一開始可能什么都不會,,即使“能說會道”,也可能表現(xiàn)出“智障”或者“一本正經(jīng)地胡說八道”,。

然而,,在持續(xù)的大樣本訓(xùn)練和算法不斷迭代的過程中,有一天它就能達(dá)到像ChatGPT,、GPT-4那樣讓人驚艷的理解能力、推理能力和表達(dá)能力,。

2,、“讀萬卷書、行萬里路,、與萬人談” vs“預(yù)訓(xùn)練(Pre-Train),、精調(diào)(Fine-Tuning)”

孩子們會說話、會走路之后,,人的學(xué)習(xí)才正式開始,。

一個(gè)人的學(xué)習(xí)成長,,通常先經(jīng)過基礎(chǔ)教育、廣泛的學(xué)習(xí),,再發(fā)展為專業(yè)的,、深入某個(gè)領(lǐng)域的學(xué)習(xí)。

不僅要廣泛涉獵,,大量學(xué)習(xí)書本知識,,還要進(jìn)行實(shí)踐和與人交流。

在這個(gè)過程中,,應(yīng)用所學(xué)知識,,獲取反饋,對大腦中的知識進(jìn)行修正和提煉,,即從“知識到智慧”,,實(shí)現(xiàn)“知行合一”。

掌握了基本的知識和技能后,,人們需要找到自己的專長領(lǐng)域,。

在學(xué)校里,碩士生,、博士生和教授需要選擇一個(gè)細(xì)分領(lǐng)域進(jìn)行深入研究,。

每個(gè)人,也都需要找到自己的行業(yè)和職業(yè),。

對于GPT這樣的大型模型,,它們的發(fā)展也是通過類似的過程。

首先進(jìn)行“大規(guī)模數(shù)據(jù)集”進(jìn)行“預(yù)訓(xùn)練”,,然后利用有標(biāo)簽的樣本以及人類反饋,,通過增強(qiáng)學(xué)習(xí)(Reinforcement Learning by Human Feedback,RLHF)進(jìn)行微調(diào)和迭代,。

模型的預(yù)訓(xùn)練,,指的是在大量無標(biāo)簽數(shù)據(jù)上訓(xùn)練模型以學(xué)習(xí)基本知識。

這就像人在嬰兒階段以及從小學(xué)到高中階段進(jìn)行大量學(xué)習(xí)一樣,。不局限于某個(gè)領(lǐng)域,,而是需要廣泛且大量地輸入信息。

精調(diào)指的是在特定任務(wù)上,,利用有標(biāo)簽數(shù)據(jù)對模型進(jìn)行微調(diào),,以便更好地適應(yīng)特定任務(wù)。

這就像人在閱讀了大量書籍后,,還需要進(jìn)行實(shí)踐,,從實(shí)踐中獲得反饋并成長。

許多偉人和名人,,如毛澤東,、列寧,、馬斯克、查理·芒格等,,都非常熱愛閱讀,,并樂于與人交流,在實(shí)際工作中大量實(shí)踐,。

只有這樣,,才能獲得足夠多的知識,才能塑造出過人的智慧,。

我們時(shí)??吹揭恍╆P(guān)于“孩子因?yàn)殡u毛蒜皮之類的瑣事而做出傻事”的新聞,這通常是“嬌生慣養(yǎng)”的結(jié)果,,與模型中的“過擬合”現(xiàn)象有相似之處,。bvty寶威

所謂機(jī)器學(xué)習(xí),就是讓機(jī)器從樣本中學(xué)習(xí),,從而“擬合”出規(guī)律,,進(jìn)而掌握技能。

在訓(xùn)練模型時(shí),,如果樣本過于單一或特征選擇不當(dāng),,就容易出現(xiàn)過擬合現(xiàn)象。

過擬合意味著模型將訓(xùn)練樣本中的特殊情況誤認(rèn)為是普遍情況,。

如此一來,,在面對新的樣本時(shí),模型就無法做出正確的處理,。

同樣,,嬌生慣養(yǎng)(過擬合:over-fitting)導(dǎo)致的脆弱心智(模型)在面臨現(xiàn)實(shí)世界中的各種挫折時(shí),往往無法正確應(yīng)對(預(yù)測不準(zhǔn)確,、泛化能力差),,從而很容易導(dǎo)致不幸的結(jié)果。

因此,,我們應(yīng)該讓孩子面對各種情況,,并給予反饋,讓他們了解并適應(yīng)真實(shí)世界,。

人的教育有兩種類型,,一種是從小就教他一門手藝。比如“做菜,、開車、做鐵匠,、木匠”等等,,這樣他就成為了一個(gè)專才,。另外,就是先是漫長的基礎(chǔ)教育,,再是高等,、專業(yè)教育。先打好基礎(chǔ),,再選擇專業(yè)方向,。模型跟人一樣,你給他輸入什么,,他就有什么樣的輸出,,他就有什么樣的知識技能。在大模型之前,,大家熟知的貓狗識別,、指紋識別、人臉識別等等模型,,就是做特定的事情,,類似于職業(yè)教育。

這樣的模型可以稱為“小模型”,,一方面是模型的size小,,另外一方面是模型的能力范圍比較窄。GPT這樣的模型之所以稱為大模型,,既是因?yàn)橛?xùn)練數(shù)據(jù)集規(guī)模大,、訓(xùn)練出的模型size大,也指的是模型有廣泛的能力,,好像是“上知天文,、下知地理”。讀萬卷書,,就是大模型,,發(fā)展出通用智能。只讀菜譜,、只練廚技,,就是小模型,發(fā)展特定技能,。

我們可以從以下三個(gè)方面,,來形象化地理解大模型。

首先,,以腦容量作為比喻,。模型的大小就像動物的腦容量一樣,較大的腦容量通常意味著更高的智慧。擁有更多神經(jīng)元和神經(jīng)元間連接的大腦,,才能夠儲存更多知識,。

其次,以字典作為比喻,。如果一個(gè)語言的字典僅包含十個(gè)字,,那么這個(gè)語言能表達(dá)的意義將非常有限。然而,,如果字典中有數(shù)萬個(gè)字,,那么它就能表達(dá)更豐富的信息。

最后,,以書籍進(jìn)行類比,。為什么大模型更具威力?

以GPT-3為例,,其模型有800GB,,即8000億個(gè)字節(jié),粗略地估算相當(dāng)于4000億個(gè)字,。假設(shè)一本書有20萬字,,那么這就相當(dāng)于200萬本書。

可以說,,這“濃縮”的200萬本書基本上能夠涵蓋人類幾乎所有的知識,,且不重復(fù)。

(需要認(rèn)識到的是,,成千上萬年來,,人類知識的記錄和傳承基本上就是通過語言和書籍形式進(jìn)行的。)

因此可見,,足夠大的模型,,就能涵蓋足夠多的知識。

大模型,,就有大智慧,。

常規(guī)的語言模型能力相對有限,比如進(jìn)行分詞,、詞性判斷等,,最多完成翻譯等任務(wù)。

GPT作為“大語言模型(Large Language Model, LLM)”之所以如此強(qiáng)大,,是因?yàn)橐婚_始它并沒有特定的目的性,,不是預(yù)設(shè)讓模型完成某一個(gè)任務(wù),而是給模型廣泛地輸入和訓(xùn)練,。

在學(xué)生作文能力的培養(yǎng)上,,有兩種方法。

一種是以提升作文能力為目標(biāo),,讓孩子閱讀各種作文技巧的書籍,、參加各種作文培訓(xùn)班。但這樣急于求成的方法,,效果其實(shí)并不理想,。

另一方面,有些家長鼓勵(lì)孩子從小養(yǎng)成閱讀的習(xí)慣,,博覽群書,。

這樣一來,孩子的閱讀能力,、知識面,、思維能力都會得到很大提升,作文能力自然隨之提高,。

而且,,由于閱讀速度、理解能力的增長,,孩子在讀題,、審題方面的速度和準(zhǔn)確率也會提高,從而提升其他學(xué)科如數(shù)學(xué),、物理,、化學(xué)等的成績。

更為重要的是,,閱讀不僅能提高成績,,還能塑造一個(gè)人的世界觀、氣質(zhì),,并增強(qiáng)內(nèi)心的力量,。

可以說,對一個(gè)人的一生都會產(chǎn)生深遠(yuǎn)影響,。

因此,,我們不應(yīng)急功近利,而應(yīng)培養(yǎng)“大模型”,。有了大模型,,各種能力自然而然就會呈現(xiàn),。

人們常說,人如其文,。一個(gè)人的文字能夠體現(xiàn)出其思考能力,、表達(dá)能力等綜合素質(zhì)。

模型也是如此,,ChatGPT的能力體現(xiàn)在它的回答中,,體現(xiàn)在一個(gè)個(gè)輸出的字中。

首先要說明的是,,ChatGPT在回答問題時(shí),,一個(gè)字一個(gè)字地慢慢往外蹦,并非因?yàn)榫W(wǎng)絡(luò)速度的問題,,而是因?yàn)槟P途褪且赃@種方式工作的:它根據(jù)當(dāng)前的情境,,不斷地推理出下一個(gè)應(yīng)該輸出的字(將概率最高的字輸出出來)。

因此,,“準(zhǔn)確預(yù)測下一個(gè)要輸出的字符”是模型能力的關(guān)鍵,。

為了讓你更好地理解這個(gè)概念的重要性,我來舉一個(gè)例子,。

假設(shè)有一部推理小說,,故事情節(jié)跌宕起伏、線索錯(cuò)綜復(fù)雜,。

小說的最后,,有一句話:“兇手是______?!?/p>

如果AI在讀到這里時(shí)能輸出正確的字符,,那么就證明這個(gè)模型非常強(qiáng)大。

表面上是字符,,實(shí)際上是智能,。

GPT是“Generative Pre-trained Transformer”的縮寫,其中Transformer是一種深度學(xué)習(xí)架構(gòu),,具體指的是一種基于自注意力(self-attention)機(jī)制的神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu),。

這個(gè)概念至關(guān)重要,但的確難以理解,。

下面,,嘗試解釋一下。

你可以“顧名思義”,,用“變形金剛”這部電影來做類比,。

變形金剛就是把一輛汽車零件打散,然后再變成一個(gè)人,。

這個(gè)過程就像Transformer中的“編碼,、解碼”的過程,。

將輸入序列(比如汽車)解碼成不同的部分(各個(gè)零件),并記憶部件之間的連接關(guān)系(通過自注意機(jī)制,,self-attention),,然后再根據(jù)相關(guān)信息組裝成輸出序列(如人型機(jī)器人)。

在這個(gè)過程中,,Transformer可以捕捉輸入序列中的長距離依賴關(guān)系,,從而實(shí)現(xiàn)更高效且準(zhǔn)確的序列處理。

人要跟上社會發(fā)展,,不僅要在學(xué)生時(shí)代好好學(xué)習(xí),,更重要的是在日常的工作和生活中不斷學(xué)習(xí)、終身學(xué)習(xí),。機(jī)器之所以這么厲害、AI之所以這么強(qiáng)大,,就是因?yàn)槿思以诓粩鄬W(xué)習(xí)啊,。

更何況,機(jī)器的記憶力,、學(xué)習(xí)速度,,可是人的成百上千倍。

看看我們,,一邊在擔(dān)憂“自己會不會被AI代替”,,一邊整天慵懶地握著手機(jī)在打游戲、刷視頻,。

懶惰的人類,,要努力了啊,!

科學(xué)技術(shù)發(fā)展到今天,,人類對自己的大腦有了一定的了解,但完全談不上深入,、透徹,。

同樣,對于利用深度神經(jīng)網(wǎng)絡(luò)技術(shù)打造出的AI模型,,也存在“可解釋性”的問題,。

盡管模型很強(qiáng)大,能識別出貓狗,、能對答如流,、能寫代碼、能畫畫,,但即使是模型的開發(fā)者,,也無法準(zhǔn)確地說明,,某個(gè)結(jié)果是如何具體產(chǎn)生的。

可以說,,人類用原理不明的大腦,,開發(fā)出原理不明的大模型。

老子說,,道可道非常道,。

對于AI來說,也是如此,。

太簡單的模型,,的確不會有強(qiáng)大的能力。

專欄作家

朱百寧,,微信公眾號:八點(diǎn)三十五,,人人都是產(chǎn)品經(jīng)理專欄作家。前百度品牌總監(jiān),、螞蟻產(chǎn)品總監(jiān),,著有《自傳播》一書,現(xiàn)在專注于人工智能以及產(chǎn)品設(shè)計(jì)等領(lǐng)域,。

本文原創(chuàng)發(fā)布于人人都是產(chǎn)品經(jīng)理,。未經(jīng)許可,禁止轉(zhuǎn)載,。

題圖來自 Unsplash,,基于CC0協(xié)議。

該文觀點(diǎn)僅代表作者本人,,人人都是產(chǎn)品經(jīng)理平臺僅提供信息存儲空間服務(wù),。

bvty寶威VIP

推薦產(chǎn)品

同類文章排行

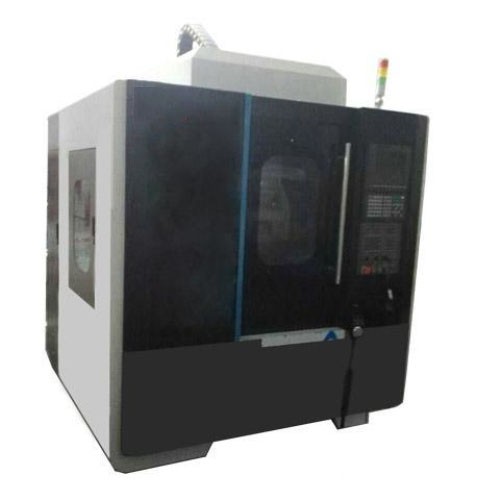

- 精雕機(jī)的錯(cuò)位原因有那些?

- 數(shù)控精雕機(jī)主軸加工后的保養(yǎng)方法

- cnc高光機(jī)在使用時(shí)候需要注意什么

- 一個(gè)高端數(shù)控系統(tǒng)對精雕機(jī)的重要性

- 精雕機(jī)不歸零加工完閉后不回工作原點(diǎn),?

- 主軸達(dá)不到指定轉(zhuǎn)速,?

- 高光機(jī)主軸軸承容易壞的原因

- 手機(jī)邊框高光機(jī)的特點(diǎn)

- 五金高光機(jī)的質(zhì)量判斷的四大標(biāo)準(zhǔn)

- 開機(jī)無反應(yīng),機(jī)床沒電,,手柄無反應(yīng),,不顯示?

同類文章排行

- bvty寶威VIP:鈑金折彎加工最怕折什么材料,?

- bvty寶威VIP:五金件與塑膠件之間的連接方式

- bvty寶威VIP:杭州笑祺五金制造取得一種精密鈑金件加工用

- bvty寶威VIP:忠藝隆五金丨鈑金機(jī)箱加工表面噴塑處理工藝

- 東莞絲科五金實(shí)業(yè)取得五金件拋光設(shè)備專利,,提高拋光質(zhì)量和一致性

- 上海昱創(chuàng)實(shí)業(yè)取得汽車鈑金件沖孔工裝專利,,便于對汽車鈑金件進(jìn)行

- 鉑源五金|鈑金加工常用的三種金屬板材

- 鈑金機(jī)箱加工件被銹蝕后,該如何處理,?

- bvty寶威VIP:最全的鈑金件結(jié)構(gòu)設(shè)計(jì)準(zhǔn)則,,粗中帶細(xì),細(xì)中

- 蘇州錢江精密五金取得拼接式鈑金件專利,,實(shí)現(xiàn)緩沖器可以在鈑金件