bvty寶威VIP:我們?nèi)绾斡?xùn)練和應(yīng)用大模型

作者 | 褚杏娟

大模型在過去半年多時間里狂飆突進,,但最近的大模型應(yīng)用已經(jīng)開始降溫,。要不要用,、怎么用大模型成為現(xiàn)在大家需要解決的問題,。我們邀請了具有多年實踐經(jīng)驗的數(shù)禾科技 AI 技術(shù)負(fù)責(zé)人楊春勇,,來一起聊聊企業(yè)如何落地大模型,。

楊春勇表示,大語言模型已經(jīng)構(gòu)成了一個自己技術(shù)棧,,強調(diào)了在特定情景下它的優(yōu)勢,,如降低成本、提升效率,。但傳統(tǒng)的 NLP 技術(shù)依然有其重要性,,大模型是其有益補充,。每家公司可以根據(jù)實際情況嘗試不同的開源模型。而企業(yè)在大型模型落地中,,需要綜合考慮多個因素,。除了做好技術(shù)選型,企業(yè)還需審慎評估數(shù)據(jù)難題以及在算力和人力上的投入成本,。

下面文字根據(jù)直播內(nèi)容整理,,在不改變原意基礎(chǔ)上進行了刪減,完整版可以點擊查看直播視頻,。

InfoQ:數(shù)禾科技開發(fā)了一個非常有趣的模型——反詐騙模型,,當(dāng)時是如何開發(fā)出這個模型的呢?

楊春勇:在借還款環(huán)節(jié)中,,反詐模型發(fā)揮著重要作用,。在這個階段,詐騙分子常常利用借還款環(huán)節(jié)進行違法活動,,我們的目的是保護客戶的合法權(quán)益,,防止他們成為欺詐的受害者。因此,,基于當(dāng)下領(lǐng)先的深度學(xué)習(xí)和大數(shù)據(jù)技術(shù),,我們建立了設(shè)備風(fēng)險識別、行為風(fēng)險識別以及關(guān)聯(lián)風(fēng)險識別等多個識別體系,,開發(fā)出了適用于不同詐騙場景的多種反詐模型,,能夠提前識別并攔截異常行為。在這個反詐體系的幫助下,,自 2020 年至 2022 年,,詐騙案件數(shù)量顯著下降,提前攔截率達到了 92%,。結(jié)合反詐模型和人工審核,,我們成功保護了超過 3 萬名用戶,其中有 6000 多人因為及時的提醒和攔截而避免了電信詐騙,,總計防止用戶被騙金額超過 1 億元,。

除了反詐模型,,我們還利用大量的機器深度學(xué)習(xí)技術(shù)關(guān)注借款用戶面臨的問題,。例如,在最近北方發(fā)生洪澇災(zāi)害時,,一些受困的用戶無法與搜救人員取得聯(lián)系,,于是他們聯(lián)系到我們,我們針對緊急情況安排專員與他們對接,,協(xié)助救援工作,,確保這些用戶得到及時救援。

InfoQ:金融場景的大模型應(yīng)用有哪些?

楊春勇:在金融領(lǐng)域,,由于大模型相對較新,,我們正處于探索階段。數(shù)禾科技目前已經(jīng)在內(nèi)部服務(wù)臺應(yīng)用中使用大模型進行相關(guān)的服務(wù)問答,,并在用戶營銷場景中使用大模型生成素材,。除了這些已經(jīng)在使用的場景,大模型還適用于輔助分析和輔助工作,。我們也正在開發(fā)一個名為數(shù)禾助手的輔助工具,,類似于 ChatGPT,但我們將其定位為特定領(lǐng)域的助手,,更具體地說就是為金融公司定制的,。與此同時,我們也在探索如何將大模型直接賦能于業(yè)務(wù),,例如在風(fēng)險控制和貸后管理領(lǐng)域直接應(yīng)用大模型,。

實際上,大模型有兩個方面的應(yīng)用,,一是模型本身的研發(fā),,需要加強其理解能力;二是將大型模型與業(yè)務(wù)場景結(jié)合,,讓其直接在場景中發(fā)揮作用,。我們的投入主要集中在后者,即如何更好地將大型模型應(yīng)用于實際場景,。我們將調(diào)整大模型的理解能力以適應(yīng)金融行業(yè)的需求,,并根據(jù)不同應(yīng)用場景進行優(yōu)化。我們的目標(biāo)是讓大模型與內(nèi)部各項資源連接,,最終實現(xiàn)為業(yè)務(wù)賦能的目標(biāo),。

InfoQ:就整個行業(yè)而言,您注意到適合應(yīng)用大模型的場景有哪些,?

楊春勇:大模型在很多方面都可以發(fā)揮作用,,特別是在輔助分析和工作方面。輔助分析,,簡而言之,,就是利用大模型幫助完成一些業(yè)務(wù)智能(BI)任務(wù)。以前,,數(shù)據(jù)分析通常需要手動下載數(shù)據(jù),、編寫代碼、創(chuàng)建可視化和計算統(tǒng)計信息,,而現(xiàn)在,,我們可以將數(shù)據(jù)提供給大型模型,,利用其能力生成分析代碼、執(zhí)行代碼并獲得所需的分析結(jié)果,。在這些場景中,,大模型發(fā)揮著重要作用,尤其是對于那些以數(shù)據(jù)為基礎(chǔ)的公司來說,,這樣的應(yīng)用有很大的前景,。

此外,大模型還可以在輔助工作方面發(fā)揮作用,。它可以幫助規(guī)劃任務(wù),,特別是在你對某個領(lǐng)域不熟悉的情況下。你可以向大型模型提問,,它會告訴你如何分步進行任務(wù),,從第一步到第三步,甚至可以實現(xiàn)自動化,,類似于現(xiàn)在流行的 AutoGPT,。這樣,大模型可以自動執(zhí)行并輸出你需要的結(jié)果,,實現(xiàn)對工作的輔助,。之前提到過,我們在很多領(lǐng)域都廣泛使用大型模型,,包括內(nèi)部服務(wù)問答和營銷場景,,這些用途都非常典型。

InfoQ:有觀眾還提到了一個更為細(xì)分的領(lǐng)域——消費信貸,。金融領(lǐng)域是否已經(jīng)細(xì)化到了消費信貸這種更具體的大模型了嗎,?

楊春勇:盡管有許多公司在探索行業(yè)大模型,但我們的看法可能與其他公司不同,。有些公司可能只是在現(xiàn)有模型中添加了一些金融術(shù)語的知識,,這種知識添加僅限于對術(shù)語的解釋。

然而,,在實際應(yīng)用中,,對于這個行業(yè)來說,模型所需的一些數(shù)據(jù),,比如任務(wù)執(zhí)行步驟等,,可能并不充分或未被積累。這就導(dǎo)致了一個情況,,即雖然在金融術(shù)語的理解上可能有所優(yōu)勢,,但在實際的落地應(yīng)用中可能并不適用,。因此,,需要更進一步的細(xì)化,,深入到各個領(lǐng)域的細(xì)節(jié)中,看看哪些部分更適合落地應(yīng)用,。

目前,,很多數(shù)據(jù)準(zhǔn)備工作仍然不夠完善。我認(rèn)為當(dāng)前的做法是,,先讓每家公司嘗試應(yīng)用,,然后在使用過程中不斷迭代,這可能是更好的方式,。僅僅依靠現(xiàn)有的金融百科知識,、術(shù)語解釋來構(gòu)建大型模型,可能無法很好地支持相關(guān)的實際工作,。

InfoQ:經(jīng)過微調(diào)的模型是否可以適應(yīng)特定領(lǐng)域的需求,?

楊春勇:關(guān)于微調(diào)模型的構(gòu)建過程,有幾個方面需要考慮,。首先,,大模型的構(gòu)建應(yīng)用方式目前主要可以分為四大類:

第一種是通過與向量數(shù)據(jù)庫結(jié)合,實現(xiàn)企業(yè)相關(guān)的問答服務(wù),;

第二種是利用大模型的生成能力,,生成文本和圖像素材;

第三種是利用大模型的規(guī)劃能力,,構(gòu)建智能體應(yīng)用,;

第四種是利用大模型的代碼生成和接口調(diào)用能力,實現(xiàn)自動化工具與使用工具的應(yīng)用,,同時還可以進行相關(guān)分析任務(wù),。

舉個例子,以知識庫問答服務(wù)為例,,構(gòu)建過程涉及以下步驟,。首先,需要收集企業(yè)的典型問答數(shù)據(jù),,并將其進行分割和向量化表示,,然后將這些向量存入向量數(shù)據(jù)庫以便后續(xù)檢索bvty寶威VIP。當(dāng)用戶提問時,,我們會將用戶提問轉(zhuǎn)化為向量表示,,并通過相似度算法從向量數(shù)據(jù)庫中檢索相關(guān)的知識。最后,,我們根據(jù)檢索到的知識和提問構(gòu)建一個提示,,模型會根據(jù)這個提示生成回答。

關(guān)于微調(diào)模型,,微調(diào)是一個模型選擇的過程,,需要考慮多方面的因素,。首先,要選擇一個適合的模型,,而選擇需要考慮場景,、成本和效率等因素。在選擇模型時,,可以使用自有場景的數(shù)據(jù)集和公開數(shù)據(jù)集進行測試,,以選擇最適合自己場景的模型。其次,,要考慮成本,,可以使用開源大模型或云服務(wù)接口來滿足大部分需求,只有在一些特定情況下需要自研,。效率方面,,不是模型越大越好,需要根據(jù)實際需求選擇合適大小的模型,,以獲得更大的吞吐率和更高的效率,。

微調(diào)過程涉及三個階段。首先是有監(jiān)督微調(diào)階段,,使用高質(zhì)量標(biāo)注數(shù)據(jù)對模型進行微調(diào),,使其具備行業(yè)相關(guān)的知識和行為能力,這有助于模型在特定領(lǐng)域中的表現(xiàn),。然后是訓(xùn)練獎勵模型,,用于評估回答的合理性,獎勵模型在微調(diào)的第一階段也可能會用到,。最后是基于獎勵模型的強化學(xué)習(xí)微調(diào)階段,,通過 PPO 方法使模型的回答與人類回答對齊,以減少不合理或有害的回答,。

整個微調(diào)過程需要驗證和檢測,,以確保模型在實際場景中的表現(xiàn)符合預(yù)期。最后需要強調(diào)的是,,微調(diào)模型的過程中還需關(guān)注遺忘問題,。微調(diào)后模型可能在某些方面提升,但通用能力可能下降,。在微調(diào)中可能需要進行一些混合訓(xùn)練,,以防止模型在特定領(lǐng)域微調(diào)時遺忘通用知識。這是微調(diào)過程中需要考慮的一些關(guān)鍵點,。

InfoQ:大家普遍認(rèn)為微調(diào)可以通過使用開源模型并進行微調(diào)來降低成本,,具體的實現(xiàn)方式是怎么的?

楊春勇:微調(diào)的成本降低方法實際上有多種途徑。我們目前主要采用了一種叫做 QLoRA 的方式,,這種方式通過對量化后的部分重要結(jié)構(gòu)微調(diào),,實現(xiàn)用更低成本得到微調(diào)后的模型結(jié)果。例如,,我們使用 QLoRA 在 A100 40G 顯卡上進行模型的微調(diào),,這種配置對于大部分企業(yè)和行業(yè)模型已經(jīng)足夠,,單個分支在 40G 的顯存下只需約 26G,,訓(xùn)練速度也很快,一個 5 萬條中文數(shù)據(jù)集只需 12 小時就可以完成訓(xùn)練,,極大地節(jié)省了成本,。

不過,每家公司的情況不同,,要考慮自身的基礎(chǔ)架構(gòu),。有些公司可能擁有自有基礎(chǔ)設(shè)施,比如運維團隊和機器設(shè)備,,從而不需要過多的成本投入,。然而,對于沒有這些資源的公司,,可以考慮云廠商提供的云原生服務(wù),,這樣訓(xùn)練時能夠彈性使用資源,從而在成本上更加靈活,。云廠商提供的彈性擴容和縮容功能也有助于在推理時降低成本,。

綜上所述,降低微調(diào)成本主要有兩個方向:第一個方向是通過微調(diào)加速的方法,,包括使用更低的 GPU 和顯存,;第二個方向是通過云廠商提供的彈性服務(wù),根據(jù)具體使用情況靈活調(diào)整資源,。

InfoQ:關(guān)于微調(diào)效果的問題,,您有什么建議?

楊春勇:關(guān)于微調(diào)效果的問題,,是否有效取決于具體情況,。并不一定是僅僅由提示造成的問題。你需要根據(jù)評測結(jié)果來判斷,。如果你發(fā)現(xiàn)微調(diào)后在現(xiàn)有任務(wù)場景中表現(xiàn)不佳,,那確實和提示有可能有關(guān)。這時,,可能需要準(zhǔn)備更多的提示,。例如,ChatGPT 在提示和回答之間通常需要多輪回答,,但很多公司可能沒有足夠的數(shù)據(jù)和條件,,導(dǎo)致微調(diào)效果受限,。目前,微調(diào)最大的難題可能是數(shù)據(jù)問題,,但尚沒有明確的解決辦法,。

數(shù)據(jù)對于大模型的落地確實存在一定要求。不同企業(yè)的數(shù)據(jù)情況各異,,有些企業(yè)可能本身沒有足夠的數(shù)據(jù)收集,,但在特定場景下也許足夠使用,例如構(gòu)建問答服務(wù)企業(yè)的知識庫時,,可以直接使用現(xiàn)有的知識庫和文檔數(shù)據(jù)進行微調(diào),。

大模型的迭代是一個更復(fù)雜的問題。如何建立一個讓大模型不斷優(yōu)化的體系對于很多企業(yè)來說是具有挑戰(zhàn)性的,。在特定領(lǐng)域使用通用模型時,,很多問題可能無法解決,此時如何獲取并回應(yīng)不能解決問題的反饋,、然后對模型進行迭代,,是一個關(guān)鍵的問題。這種迭代可以使大模型更加適應(yīng)特定領(lǐng)域,,最終實現(xiàn)行業(yè)級別的應(yīng)用,。

在引入新元素時,需要考慮如何實現(xiàn)迭代,,特別是在面對解決不了的問題時,,如何推動它的進化。我們正在思考這個問題,,從用戶界面的角度出發(fā),,通過應(yīng)用的用戶界面來獲取良好的反饋。此外,,還需要考慮在大模型應(yīng)用失敗時如何通過人工分發(fā)進行兜底,。同時,還需要建立一個完善的日志系統(tǒng)以及訓(xùn)練數(shù)據(jù)分析系統(tǒng)等,,以確保在這個基礎(chǔ)上實現(xiàn)大模型的自動迭代和演進,。

企業(yè)無需過于擔(dān)憂自身的數(shù)據(jù)體系是否存在問題,而是應(yīng)先開始使用大模型,。然后,,建立一個剛剛所提到的迭代演進系統(tǒng),我認(rèn)為這種方法可能會比依賴外部的所謂行業(yè)大模型更加可靠,。

InfoQ:目前在行業(yè)中是否已經(jīng)形成了完整的大模型應(yīng)用技術(shù)棧呢,?

楊春勇:之前我們已經(jīng)介紹了大語言模型的應(yīng)用構(gòu)建方式,這也涵蓋了大模型技術(shù)棧的一些方面。在這個技術(shù)棧中,,我們需要使用一系列的技術(shù)和工具來構(gòu)建應(yīng)用,,例如在構(gòu)建知識庫問答服務(wù)時,向量數(shù)據(jù)庫是其中之一,,我們需要了解其工作原理,。同時,提示工程也是關(guān)鍵,,它能夠提升應(yīng)用效果,。任務(wù)規(guī)劃編排也是技術(shù)棧的一部分,可以借助開源技術(shù)如 LangChain 和 LangFlow 來實現(xiàn),。大模型的緩存和監(jiān)控也不可或缺,。

此外,,微調(diào)大模型也是技術(shù)棧中的一環(huán),。對比傳統(tǒng)的 NLP 模型,大模型是一個補充,,它在許多情況下表現(xiàn)出色,。然而,對于一些特定領(lǐng)域,,專有的 NLP 模型仍然更優(yōu),。大模型在沒有數(shù)據(jù)標(biāo)注的情況下能夠取得良好結(jié)果,尤其適用于數(shù)據(jù)標(biāo)注成本高昂的場景,。

總之,,大語言模型構(gòu)成了一個自己技術(shù)棧,強調(diào)了在特定情景下它的優(yōu)勢,,如降低成本,、提升效率。同時,,傳統(tǒng)的 NLP 技術(shù)依然有其重要性,,大模型是其有益補充。每家公司可以根據(jù)實際情況嘗試不同的開源模型,。

InfoQ:金融領(lǐng)域強監(jiān)管的特點,,會對我們在選擇模型方面會帶來哪些限制?

楊春勇:在金融領(lǐng)域,,強監(jiān)管特點會對模型選擇產(chǎn)生限制,,一些外部模型如 ChatGPT 可能無法使用,很多云廠商內(nèi)部提供的模型,,如阿里,、訊飛、星火等,在國內(nèi)某些場景中可能是可用的,,且不受監(jiān)管問題影響,。

在內(nèi)部使用模型時,企業(yè)需根據(jù)是否用于內(nèi)部應(yīng)用或外部構(gòu)建應(yīng)用進行區(qū)分,。內(nèi)部應(yīng)用的監(jiān)管要求較為寬松,,但對于外部應(yīng)用則需要更多考慮,包括全方位評估和微調(diào),。

模型的微調(diào)是關(guān)鍵階段之一,,尤其是對于有害性的降低。盡管一些技術(shù)如 RHF 可用于降低模型有害性,,但目前尚未完全解決,,仍存在挑戰(zhàn)。類似近期的 OpenAI 辦的“黑客比賽”也反映出該問題的挑戰(zhàn)性,,需要學(xué)術(shù)界和工業(yè)界共同努力解決,。

總體來說,合規(guī)問題是首要關(guān)注點,,然后逐步提升模型的安全性,。雖然不能馬上實現(xiàn)完美解決,但不能因此完全放棄使用模型,,而應(yīng)在不斷的迭代和提升中尋找平衡,。

InfoQ:當(dāng)前的大模型技術(shù)棧中,數(shù)據(jù)存儲和訪問的方式是否發(fā)生了重大演變,?

楊春勇:當(dāng)前的大模型技術(shù)棧中,,數(shù)據(jù)存儲方式確實發(fā)生了重大的演變——我們引入了向量數(shù)據(jù)庫作為一個重要的組件。與傳統(tǒng)的數(shù)據(jù)庫不同,,向量數(shù)據(jù)庫旨在處理非結(jié)構(gòu)化的數(shù)據(jù),,如文檔、圖像,、音頻等,。這個概念并不是新的,早在上世紀(jì) 90 年代,,美國國立衛(wèi)生研究院和斯坦福大學(xué)就開始使用向量數(shù)據(jù)庫,。

在大模型時代,向量數(shù)據(jù)庫扮演了關(guān)鍵的角色,。它設(shè)計了一些索引方式,,使我們能夠根據(jù)對象的數(shù)值進行高效的檢索,例如我們可以搜索相似的文本內(nèi)容,、可以根據(jù)語義搜索圖像和音頻,。向量數(shù)據(jù)庫逐漸成為大模型時代中不可或缺的存儲組件,。開源的向量數(shù)據(jù)庫如 Facebook 的 Faiss、Milvus,、Annoy 等,,都為企業(yè)提供了可用的基礎(chǔ)。

InfoQ:企業(yè)應(yīng)該如何引入向量數(shù)據(jù)庫,?

楊春勇:對于企業(yè)來說,,需要根據(jù)實際場景來評估。首先,,你需要審查企業(yè)內(nèi)部的結(jié)構(gòu)化數(shù)據(jù)存儲方式,,確保現(xiàn)有的方式是否滿足存儲需求和應(yīng)用場景,。如果傳統(tǒng)數(shù)據(jù)庫已經(jīng)能夠滿足需求,,可能不需要引入新的向量數(shù)據(jù)庫。

目前許多開源技術(shù)和服務(wù)提供商都為企業(yè)提供了輕松接入和跟進的機會,。如果確實存在需求,,企業(yè)可以考慮將內(nèi)部數(shù)據(jù)轉(zhuǎn)型并與大模型對接,以實現(xiàn)更高的效能,。

InfoQ:金融行業(yè)使用開源大模型,,可能會面臨哪些挑戰(zhàn)或者不太理想的情況,?

楊春勇:金融行業(yè)如果使用開源模型會有一些挑戰(zhàn),。首先,不能直接使用模型,,需要進行評測并確保模型符合合規(guī)性要求,。這需要涵蓋多個方面,包括數(shù)據(jù)隱私和合規(guī)等,。對外部應(yīng)用而言,,企業(yè)需要更嚴(yán)格地考慮合規(guī)性。確保平臺設(shè)計考慮了合規(guī)性問題,,同時在評測,、調(diào)整和數(shù)據(jù)處理方面投入更多的資源。開源模型雖然提供了便利,,但評估和調(diào)整過程是不可或缺的,。

InfoQ:有觀眾問道:“很多人吐槽 LangChain 大多數(shù)工作都是在構(gòu)造 Prompt,重用性低,?!睂Υ四趺纯矗?/span>

楊春勇:LangChain 體現(xiàn)了一種設(shè)計思維,,即強調(diào)工作流的可重用性,。雖然在構(gòu)建工作流時可能需要關(guān)注重用性,,但 LangChain 本身的設(shè)計并不完全受其構(gòu)造的 Prompt 和重用 ID 的影響。關(guān)鍵在于,,其設(shè)計思想可以幫助我們串聯(lián)各種組件,,包括 AI 和其他元素的工作流,以便更好地復(fù)用組件,,這種底層思想值得我們學(xué)習(xí),。

可能有人會批評 LangChain 的代碼質(zhì)量或者相比于其參考的論文,直接實現(xiàn)可能更快,。但從另一個角度來看,,重要的是讓大家接受其理念,而不僅僅考慮代碼的質(zhì)量,。此外,,它的工程可以使不太熟悉的用戶能夠快速應(yīng)用,這種貢獻是相當(dāng)大的,。

InfoQ:有觀眾問道:“很多選型都是成本和性能的權(quán)衡,,您可以分享下私有 Embedding 和 Embedding API 做選型的話您會怎么思考嗎?”

楊春勇:在某些情況下,,并不是說外部的 embedding 或 API 在你的場景下一定會產(chǎn)生最佳效果,。我們經(jīng)過測試發(fā)現(xiàn),在某些場景中,,比如 ChatGPT 生成的 embedding,,其效果未必比常規(guī)訓(xùn)練模型改進的 embedding 效果更好。這涉及到國內(nèi)和國外的差異,,因為我們是使用中文,,一個專注于中文預(yù)訓(xùn)練模型的 embedding 可能比一個通用的多語言 embedding 更具區(qū)分度。

另外,,文本的長度也是一個影響因素,。如果文本長度不是很長,大模型的 API 和私有 embedding 的差距可能不大,。但是,,隨著文本長度變得更長更復(fù)雜,大模型可能會帶來更好的效果,。這時,,你可以選擇使用大模型提供的 API,從而在更長文本的情況下獲得更好的效果,。

總的來說,,在一些復(fù)雜的情況下,尤其是文本較長的情況下,,使用大模型提供的 API 可能會更合適,。而對于較短的文本,,可能私有的 embedding 效果更接近,選擇更靈活,。

InfoQ:當(dāng)模型部署到生產(chǎn)環(huán)境后,,開發(fā)者如何進行后續(xù)的管理維護和迭代優(yōu)化工作?

楊春勇:關(guān)于模型部署和維護,,大模型和傳統(tǒng)模型的維護沒有太大區(qū)別,。首先,需要進行版本和數(shù)據(jù)管理,。同時,,保障線上模型的穩(wěn)定性和版本管理是必要的,方便快速回滾等操作,。此外,,自動擴縮容也是關(guān)鍵,以滿足模型的資源需求,。

另外,,部署前需要考慮資源優(yōu)化,以提高推理速度并降低資源占用,。針對這一點,,有量化、剪枝,、蒸餾等方法可以幫助實現(xiàn)目標(biāo),。底層框架也可以提供提升推理速度的方法。

最后,,在上線部署后,,建立用戶反饋系統(tǒng)至關(guān)重要,以便及時獲得有關(guān)模型輸出的反饋,。這將有助于模型的改進和調(diào)優(yōu)。整個過程需要深思熟慮,,以確保模型的有效運營和持續(xù)優(yōu)化,。

InfoQ:關(guān)于防止惡意 Prompt 注入攻擊的經(jīng)驗,您是否有相關(guān)的分享,?

楊春勇:關(guān)于 Prompt 注入這個問題,,實際上是一個相當(dāng)復(fù)雜的課題。正如之前提到的,,一些“黑客比賽”顯示出對此類問題的潛在威脅,。盡管我個人對此關(guān)注并不深入,但我認(rèn)為解決這個問題的關(guān)鍵思路可能主要集中在 RLHF 方法上,,需要在這個領(lǐng)域做出更多努力,。

InfoQ:在實施大型模型的落地過程中,,開發(fā)者可能會面臨哪些問題?

楊春勇:在將大型模型應(yīng)用于實際場景時,,需要綜合考慮多個因素,。除了前面提到的各個方面,企業(yè)還需審慎評估數(shù)據(jù)難題以及在算力和人力上的投入成本,。利用大模型構(gòu)建應(yīng)用涉及到一定難度,,尤其需要關(guān)注創(chuàng)業(yè)成本,因此對于創(chuàng)業(yè)者而言,,需權(quán)衡場景選擇和資源投入,。

事實上,許多從事大模型應(yīng)用的企業(yè)如 Jasper,,最初采用 OpenAI 的模型但隨后因為沒有自己的核心模型,,已經(jīng)開始了大規(guī)模裁員。這顯示了大模型創(chuàng)業(yè)需要審慎,,根據(jù)不同場景定制,。因此,在將大模型落地應(yīng)用中,,需結(jié)合企業(yè)場景,、資源投入、創(chuàng)業(yè)環(huán)境等因素綜合考慮,。這個過程可能需要根據(jù)場景進行研究,,并在有了清晰場景后深入研究。

InfoQ:之前楊老師提到,,選擇大模型時的一個關(guān)鍵問題是成本,。如果使用大模型構(gòu)建一個應(yīng)用,成本大致在什么數(shù)量級上,?

楊春勇:在討論應(yīng)用大型語言模型時,,其中的成本主要涉及到算力和開發(fā)方面。算力成本是一個主要因素,,然后還需要考慮應(yīng)用的開發(fā)以及系統(tǒng)集成等方面的費用,。關(guān)于成本的量級,實際上與應(yīng)用的具體情況密切相關(guān),。成本取決于多個因素,,包括應(yīng)用的開發(fā)復(fù)雜程度、并發(fā)量,、對算力的需求以及系統(tǒng)集成規(guī)模等,,因此不容易精確預(yù)測。

針對自研大模型的情況,,需要考慮 GPU 的成本以及系統(tǒng)集成的投入,。另一方面,,如果選擇使用第三方的接口,例如云廠商提供的服務(wù),,成本可能與調(diào)用的 token 數(shù)量相關(guān),。而這些 token 的使用量與業(yè)務(wù)規(guī)模和場景有關(guān),難以簡單確定成本,。此外,,系統(tǒng)集成和應(yīng)用開發(fā)屬于研發(fā)成本,這個部分也是因具體情況而異,,不容易量化,。

InfoQ:人力成本也是一項重要開銷,人力支出通常在整體成本中占多大的比例,?

bvty寶威

楊春勇:人力成本往往在這個領(lǐng)域是占據(jù)重要位置的,,可能排在開銷的第一位。不論是自主研發(fā)還是采用第三方應(yīng)用,,技術(shù)實力通常是主要投入,,盡管相對而言 GPU 等硬件開銷并不占據(jù)太大比例。bvty寶威VIP

InfoQ:您建議大家進入到這個行業(yè)里去從事相關(guān)工作嗎,?

楊春勇:當(dāng)考慮在公司內(nèi)部采用大型模型時,,重要的是不要盲目追隨潮流,而是應(yīng)該根據(jù)自身的業(yè)務(wù)場景來進行判斷,。不妨從實際應(yīng)用的角度出發(fā),,了解是否能夠?qū)⒋笮湍P蛻?yīng)用到其中。

實際上,,更有意義的方法可能是從落地應(yīng)用的角度入手,,根據(jù)遇到的問題進行研究和優(yōu)化。這種方式可能更加實效,,而不是僅僅因為大型模型目前很受矚目就過早地投入大量的基礎(chǔ)性工作,。當(dāng)然在學(xué)術(shù)界可能會有不同的情況,但在工業(yè)界,,基于應(yīng)用的思路可能更加適用,。

InfoQ:您認(rèn)為,未來大模型應(yīng)用領(lǐng)域可能出現(xiàn)怎樣的發(fā)展趨勢,?

楊春勇:在大模型應(yīng)用領(lǐng)域,未來的發(fā)展趨勢可能會更加清晰,,特別是針對行業(yè)大模型?,F(xiàn)階段所謂的行業(yè)大模型或許還不夠明確,但未來行業(yè)大模型可能會建立更完善的行業(yè)落地機制,,促使大模型在各個領(lǐng)域真正落地并發(fā)揮作用,。另一方面,,我對于大模型所帶來的通用人工智能影響更加關(guān)注。

在這個領(lǐng)域,,有許多人正在從不同的角度進行研究,,未來可能會取得迅速的進展。通用人工智能的實現(xiàn)將直接影響到普通人們的生活,,它將更廣泛地應(yīng)用,,甚至包括具身智能,如實體機器人,,有可能會進入千家萬戶,。這些變化都是我們可以預(yù)見到的未來發(fā)展方向。

bvty

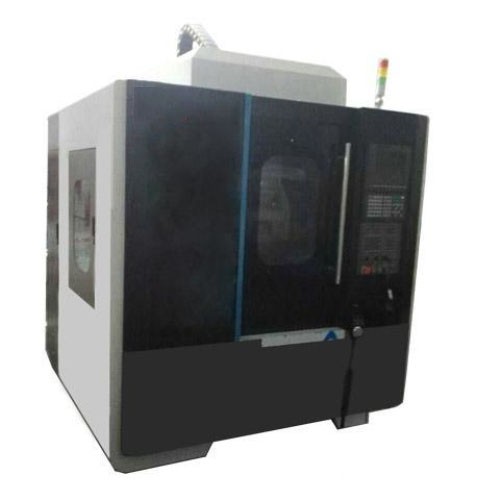

推薦產(chǎn)品

同類文章排行

- 精雕機的錯位原因有那些,?

- 數(shù)控精雕機主軸加工后的保養(yǎng)方法

- cnc高光機在使用時候需要注意什么

- 一個高端數(shù)控系統(tǒng)對精雕機的重要性

- 精雕機不歸零加工完閉后不回工作原點,?

- 主軸達不到指定轉(zhuǎn)速?

- 高光機主軸軸承容易壞的原因

- 手機邊框高光機的特點

- 五金高光機的質(zhì)量判斷的四大標(biāo)準(zhǔn)

- 開機無反應(yīng),,機床沒電,,手柄無反應(yīng),不顯示,?

同類文章排行

- bvty寶威VIP:鈑金折彎加工最怕折什么材料,?

- bvty寶威VIP:五金件與塑膠件之間的連接方式

- bvty寶威VIP:杭州笑祺五金制造取得一種精密鈑金件加工用

- bvty寶威VIP:忠藝隆五金丨鈑金機箱加工表面噴塑處理工藝

- 東莞絲科五金實業(yè)取得五金件拋光設(shè)備專利,提高拋光質(zhì)量和一致性

- 上海昱創(chuàng)實業(yè)取得汽車鈑金件沖孔工裝專利,,便于對汽車鈑金件進行

- 鉑源五金|鈑金加工常用的三種金屬板材

- 鈑金機箱加工件被銹蝕后,,該如何處理?

- bvty寶威VIP:最全的鈑金件結(jié)構(gòu)設(shè)計準(zhǔn)則,,粗中帶細(xì),,細(xì)中

- 蘇州錢江精密五金取得拼接式鈑金件專利,實現(xiàn)緩沖器可以在鈑金件